안녕하세요~ 솔루디오입니다^^

AI 공부를 좀 하고 안다고 한다면, 알아야 할 단어가 있죠.

"딥러닝"

요즘은 AI로 완전히 넘어오면서 이전보다는 관심이 덜해지기는 했어요^^

처음에 이 개념을 접했을 때에는 많이 어려웠지요. "딥러닝이 뭔데 그렇게 대단하다는 거야?"

솔직히 논문수준까지 깊은 내용을 우리가 알 필요는 없죠. 너무 복잡하고 어려운 수학적인 알고리즘의 집합체이지만 우린 AI를 이해하는 정도의 수준으로만 공부를 해요^^

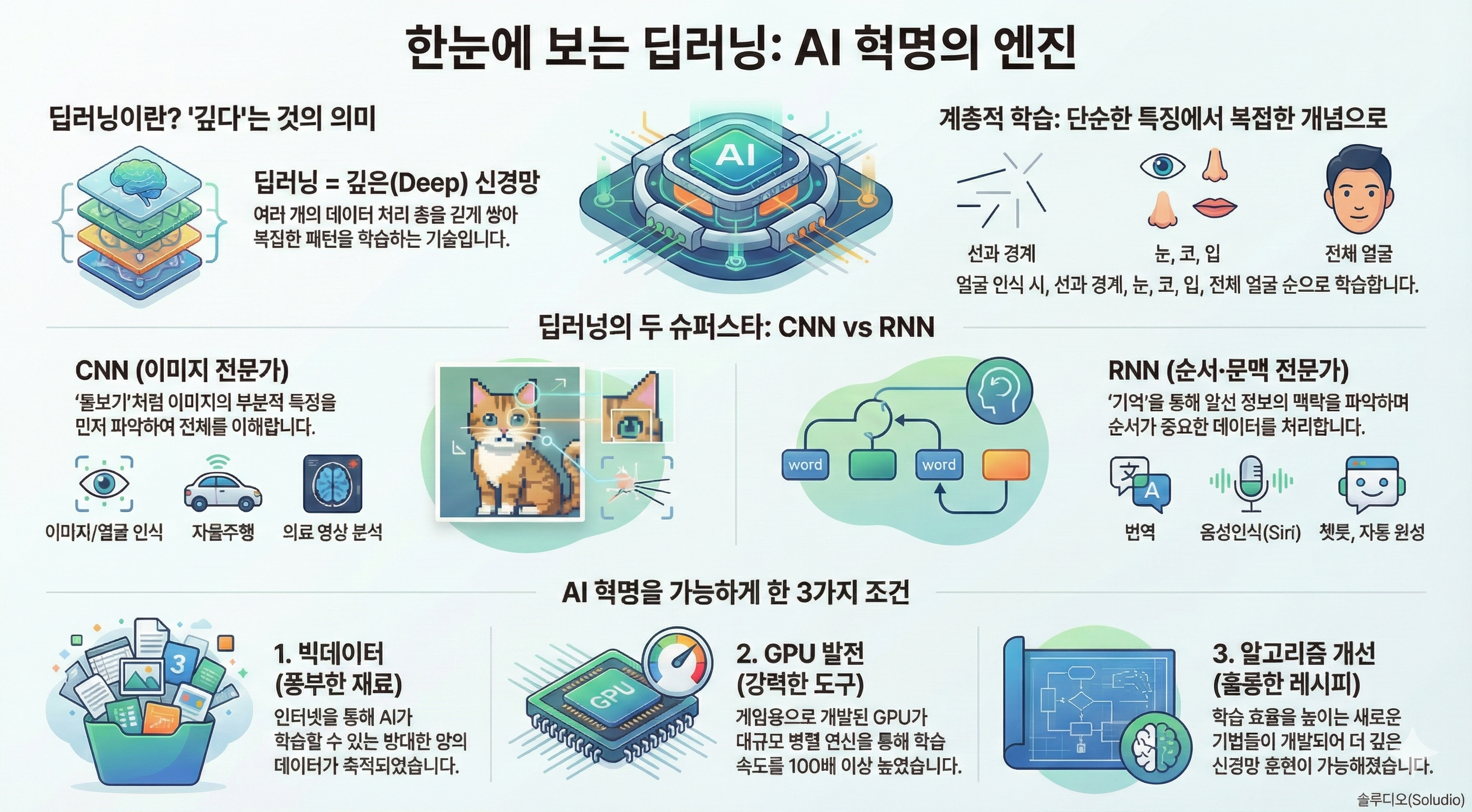

딥러닝 = "깊은" 신경망

그냥 이거예요. 깊다는 것은 층이 많다는 말이니, "층이 많은 신경망"이라는 뜻입니다.

"그게 뭐가 대단한데?"

아, 이게 생각보다 엄청난 차이를 만들어요!

이전 글을 읽고 오시면 더 이해하기 좋아요^^

- [AI 개념 정리 4] 인공 신경망(Neural Network 이란? 회사 조직 구조, 채용 결정 예시를 통해 AI 쉽게 이해하기(뉴런, 신경망)

- [AI 개념 정리 3] AI 알고리즘 원리, 넷플릿스와 요리 레시피로 5분 만에 이해하기(패턴인식, 의사결정트리)

- [AI 개념 정리 2] AI는 어떻게 공부할까? 넷플릭스와 알파고로 배우는 머신러닝 원리

- [AI 개념 정리 1] AI 종류 완벽 정리: 약한 AI와 강한 AI 차이점은? (feat. ChatGPT)

지난 이야기: 인공 신경망에서 딥러닝으로

지난 글에서 우리는 신경망을 배웠습니다. 뉴런들이 층층이 쌓여서 정보를 처리하는 구조였죠.

입력층 → 은닉층 → 출력층으로 이어지는 그 구조 기억나시나요?

오늘은 그 신경망을 훨씬 더 깊게 쌓으면 어떤 일이 일어나는지 알아보겠습니다.

오늘 여러분이 배울 것들

이 글을 다 읽고 나면:

✅ 딥러닝이 왜 "딥"한지 (진짜 단순해요!)

✅ CNN이 사진을 어떻게 보는지 (신기방기!)

✅ RNN이 문장을 어떻게 이해하는지 (오~ 이래서!)

✅ 왜 갑자기 딥러닝이 발전했는지 (아하! 순간)

전부 회사 조직, 요리, 소설 읽기 같은 일상 예시로 설명해 드릴게요.

자, 그럼 "깊은" 세계로 한번 들어가볼까요?

딥러닝이 '딥'한 이유

Deep = 깊다

영어 "Deep"의 뜻을 아시죠?

깊다!

그게 다예요. 진짜로요.

딥러닝(Deep Learning)은 층이 깊은 신경망을 사용하는 머신러닝입니다.

"그래서 층이 깊으면 뭐가 좋은데?"

좋은 질문입니다! 예를 들어볼게요.

한 층짜리 vs 열 층짜리

1층짜리 집:

- 넓게 퍼져 있음

- 단순한 구조

- 복잡한 걸 담기 어려움

10층짜리 빌딩:

- 층층이 쌓여 있음

- 복잡한 구조

- 많은 것을 담을 수 있음

신경망도 마찬가지예요!

얕은 신경망 (2~3층):

- 간단한 패턴만 학습

- 예: 선형 분류

딥 신경망 (10층 이상):

- 복잡한 패턴 학습

- 예: 얼굴 인식, 음성 인식, 번역

회사 조직 비유

딥러닝을 회사 조직으로 이해해봅시다.

1층 조직 (CEO 바로 밑에 사원):

CEO

↓

사원들 (100명)- 사원이 CEO에게 직접 보고

- 정보가 정리되지 않음

- CEO가 판단하기 어려움

10층 조직 (계층적 구조):

CEO (최종 결정)

↓

임원 (전략 수립)

↓

부장 (고수준 분석)

↓

과장 (패턴 분석)

↓

대리 (정보 정리)

↓

사원 (데이터 수집)각 층마다 정보가 정제되고, 더 높은 수준의 이해가 가능해집니다!

계층적 특징 학습

딥러닝의 핵심은 계층적으로 특징을 배운다는 거예요.

얼굴 인식 딥러닝을 예로 들어볼까요?

1층 (가장 낮은 층):

- 픽셀의 밝기

- 선과 경계선

- "여기 세로선이 있네"

2층:

- 선들을 조합

- 기본 도형 인식

- "세로선 + 가로선 = 사각형"

3층:

- 도형들을 조합

- 얼굴 부위 인식

- "둥근 것 2개 + 선 1개 = 눈"

4층:

- 부위들을 조합

- "눈 2개 + 코 + 입 = 얼굴"

5층:

- 얼굴 특징 분석

- "이건 엄마 얼굴이구나!"

각 층이 조금씩 더 추상적인 개념을 배우는 거죠!

음식 조리 과정 비유

요리로 비유하면 더 쉬워요.

1단계 (재료 손질):

- 양파 자르기

- 당근 깎기

- 고기 씻기

- → 기본 재료 준비

2단계 (기본 조리):

- 볶기, 끓이기

- → 재료들이 익음

3단계 (맛 조절):

- 소금, 간장 추가

- → 맛의 조화

4단계 (플레이팅):

- 예쁘게 담기

- → 완성된 요리!

각 단계가 이전 단계의 결과물을 받아서 한 단계 더 발전시키는 거예요.

얕은 vs 깊은 신경망

정리하면:

얕은 신경망:

- 층이 2~3개

- 간단한 패턴만

- 예: 직선으로 나누기

딥 신경망:

- 층이 10개 이상 (요즘은 100개도!)

- 복잡한 패턴

- 예: 얼굴 인식, 음성 인식, 번역

층이 깊어질수록 더 복잡하고 추상적인 개념을 배울 수 있습니다!

CNN - 이미지를 보는 AI

이미지 전문가, CNN

이제 딥러닝의 두 가지 슈퍼스타를 만나볼까요?

첫 번째는 **CNN (Convolutional Neural Network)**입니다.

한글로는 "합성곱 신경망"인데... 이름은 어렵지만 하는 일은 단순해요.

CNN = 이미지 전문가

사진이나 이미지를 처리하는 데 특화된 딥러닝입니다.

"이미지를 어떻게 처리하는데?"

돋보기로 사진 보기

CNN을 이해하는 가장 쉬운 방법:

돋보기로 사진을 꼼꼼히 보는 것!

큰 사진이 있다고 생각해보세요.

일반적인 방법:

- 사진 전체를 한 번에 봄

- 너무 많은 정보

- 중요한 것 놓치기 쉬움

CNN의 방법:

- 작은 돋보기로 부분부분 확인

- 왼쪽 위부터 → 오른쪽 아래까지

- 각 부분의 특징 파악

- 전체 이해

이게 바로 "합성곱(Convolution)"입니다!

퍼즐 맞추기 비유

퍼즐을 맞출 때를 생각해보세요.

1단계: 작은 조각들 확인

- 이건 하늘색

- 이건 풀색

- 이건 빨간색

2단계: 비슷한 조각끼리 모으기

- 하늘색 조각들 → 하늘 부분

- 풀색 조각들 → 잔디 부분

3단계: 큰 그림 완성

- 하늘 + 잔디 + 집 = 전체 그림

CNN도 이렇게 작은 부분부터 큰 그림을 이해합니다!

필터의 역할

CNN은 "필터"라는 걸 사용해요.

필터 = 특정 패턴을 찾는 돋보기

예를 들어:

- 필터 1: 세로선 찾기

- 필터 2: 가로선 찾기

- 필터 3: 대각선 찾기

- 필터 4: 곡선 찾기

수십, 수백 개의 필터가 이미지를 스캔하면서 다양한 특징을 찾아냅니다.

의사의 X-ray 판독 비유

의사가 X-ray 사진을 보는 과정:

1단계: 부위별로 확인

- 폐 부분 확대

- 심장 부분 확대

- 갈비뼈 부분 확대

2단계: 이상 부위 찾기

- "여기 뭔가 하얗게 보이네?"

- "이 부분이 좀 이상한데?"

3단계: 전체 진단

- "폐렴 가능성이 있습니다"

CNN도 이미지를 부분부분 확인하며 이상을 찾아냅니다!

CNN의 실제 활용

CNN은 우리 일상 곳곳에 있어요:

1. 사진 앱:

- "이 사진에 고양이가 있네요!"

- 자동 태그 추가

- Google 포토, iPhone 사진

2. 얼굴 인식:

- 스마트폰 잠금 해제

- 공항 출입국 심사

- 페이스북 자동 태그

3. 자율주행:

- 도로 인식

- 차선 인식

- 보행자 감지

- 신호등 인식

4. 의료 진단:

- X-ray 분석

- CT 스캔 분석

- 암세포 탐지

모두 CNN 덕분입니다!

RNN - 시간을 기억하는 AI

순서 전문가, RNN

두 번째 슈퍼스타는 **RNN (Recurrent Neural Network)**입니다.

한글로는 "순환 신경망"인데, 이것도 하는 일은 단순해요.

RNN = 순서 전문가

순서가 중요한 데이터를 처리하는 데 특화된 딥러닝입니다.

"순서가 중요한 데이터?"

바로 시간이 관련된 모든 것들이죠!

소설 읽기 비유

소설을 읽을 때를 생각해보세요.

첫 문장: "철수는 학교에 갔다."

두 번째: "그곳에서 영희를 만났다."

세 번째: "그녀는 울고 있었다.""그녀"가 누구인지 어떻게 알까요?

→ 앞 문장을 기억하고 있으니까!

만약 첫 번째 문장을 잊어버리면?

- "그녀"가 누군지 모름

- 문맥 이해 불가

- 이야기 파악 실패

RNN은 바로 이 **"기억"**을 가진 신경망입니다!

대화하기 비유

친구와 대화할 때:

친구: "어제 영화 봤어" 나: "어땠어?" 친구: "재미있었어!"

여기서 "어땠어?"는 "영화가 어땠어?"를 줄인 거죠.

이걸 이해하려면 바로 앞 대화를 기억해야 합니다.

RNN도 이렇게 이전 정보를 기억하면서 처리해요!

일기예보 비유

일기예보를 생각해보세요.

어제: 맑음, 기온 20도 오늘: 흐림, 기온 18도 내일: ?

내일 날씨를 예측하려면:

- 어제 날씨 기억

- 오늘 날씨 분석

- 패턴 파악

- 내일 예측

과거 정보가 없으면 정확한 예측이 불가능해요!

RNN의 구조

일반 신경망과 RNN의 차이:

일반 신경망:

입력 → 처리 → 출력 (끝!)RNN:

입력 → 처리 → 출력

↑ ↓

└───────────┘

(다시 자기한테 돌아옴!)자신의 출력을 다시 입력으로 받아요. 이게 바로 "순환(Recurrent)"입니다!

이렇게 하면 이전 정보를 기억할 수 있어요.

RNN의 실제 활용

RNN도 우리 일상에 가득합니다:

1. 번역:

- Google 번역

- "I love you" → "나는 너를 사랑해"

- 문장 전체의 맥락 이해

2. 음성 인식:

- "시리야, 날씨 알려줘"

- Siri, Alexa, Bixby

- 연속된 음성을 글자로

3. 챗봇:

- ChatGPT (초기 버전)

- 고객센터 챗봇

- 이전 대화 기억하며 답변

4. 주식 예측:

- 과거 주가 패턴 분석

- 미래 가격 예측

- (물론 100% 정확하진 않아요!)

5. 자동 완성:

- 문자 입력할 때 다음 단어 추천

- "안녕하세요. 오늘..." → "날씨가?"

모두 RNN 덕분입니다!

CNN vs RNN 정리

헷갈리지 않게 정리해볼까요?

CNN (이미지 전문가):

- 공간적 패턴 인식

- 이미지, 사진, 영상

- 예: 고양이 사진 인식

RNN (순서 전문가):

- 시간적 패턴 인식

- 문장, 음성, 시계열

- 예: "안녕하세요" 음성 인식

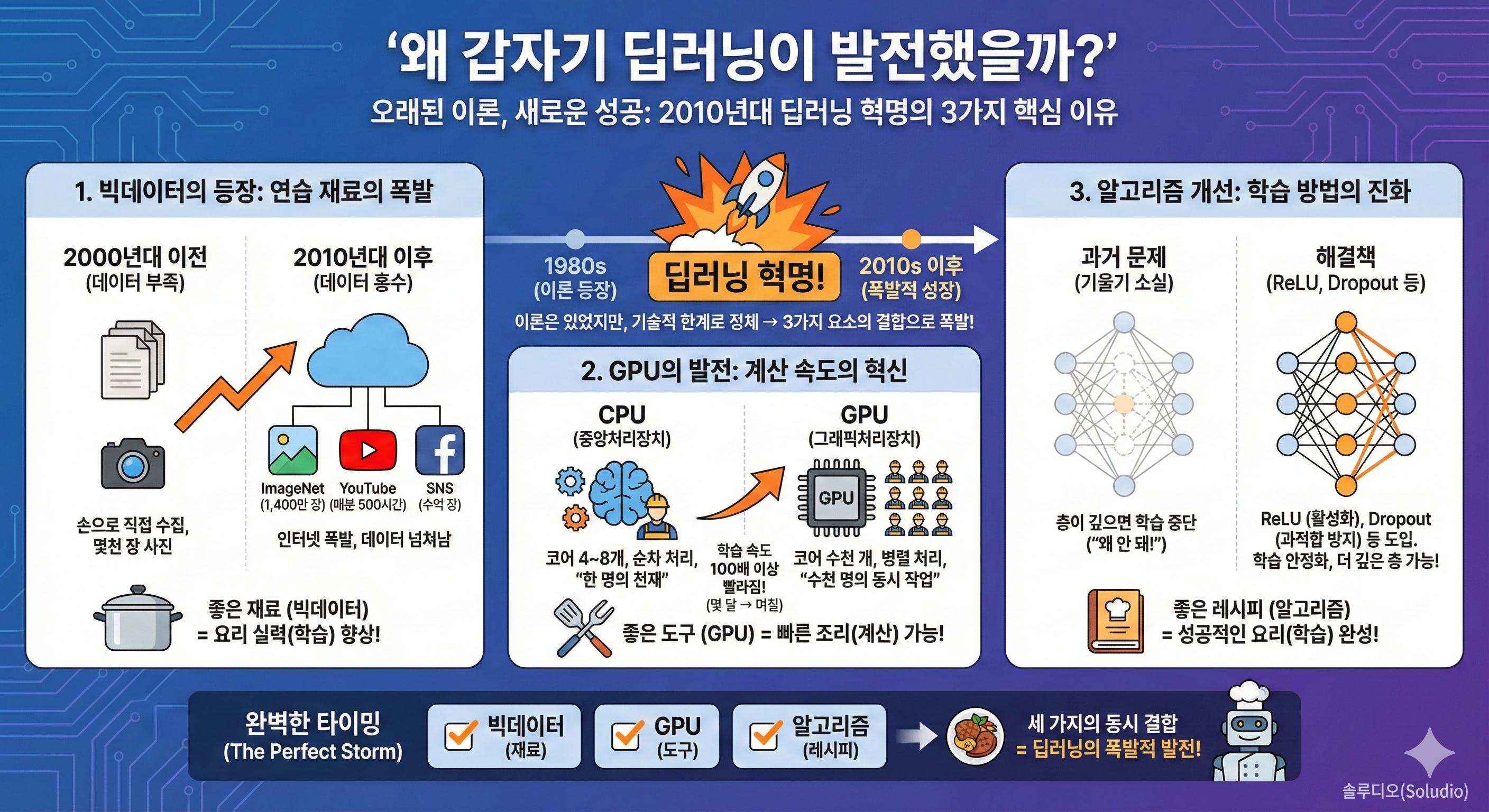

왜 갑자기 딥러닝이 발전했을까?

오래된 이론, 새로운 성공

사실 딥러닝 이론은 1980년대부터 있었어요.

"그럼 왜 지금에서야 난리인 거야?"

좋은 질문입니다!

이론은 있었지만, 실제로 작동시킬 수 없었거든요.

마치 자동차 설계도는 있는데, 엔진을 만들 기술이 없었던 것과 같아요.

그런데 2010년대에 들어서면서...

폭발! 💥

갑자기 딥러닝이 모든 분야를 정복하기 시작했습니다.

왜일까요? 3가지 이유가 있어요.

1. 빅데이터의 등장

요리 실력을 늘리려면?

연습, 연습, 또 연습!

많이 만들어볼수록 실력이 늘죠.

딥러닝도 똑같습니다. 데이터가 많을수록 똑똑해져요.

2000년대 이전:

- 데이터가 부족

- 손으로 직접 수집

- 몇천 장의 사진?

2010년대 이후:

- 인터넷 폭발

- ImageNet: 1,400만 장 이미지!

- YouTube: 매분 500시간 분량 업로드

- 페이스북, 인스타그램: 수억 장 사진

데이터가 넘쳐나기 시작했어요!

2. GPU의 발전

문제: 딥러닝 학습이 너무 느림

신경망 층이 깊어질수록:

- 계산량 폭증

- CPU로는 몇 달 걸림

- 실용성 제로

해결: GPU 등장!

CPU (중앙처리장치):

- 코어 4~8개

- 복잡한 작업 순차 처리

- "한 명의 천재가 혼자 일함"

GPU (그래픽처리장치):

- 코어 수천 개!

- 단순한 작업 병렬 처리

- "수천 명이 동시에 일함"

원래 게임용이었던 GPU를 딥러닝에 쓰니...

학습 속도가 100배 이상 빨라졌어요!

몇 달 걸리던 게 며칠로 줄어든 거죠.

3. 알고리즘 개선

문제: 층이 깊어지면 학습이 안 됨

딥러닝 초기에는 층을 깊게 쌓으면:

- 기울기 소실 (Vanishing Gradient)

- 학습이 중간에 멈춤

- "왜 안 되는 거야!" 😭

해결: 똑똑한 사람들의 발견

ReLU 활성화 함수:

- 기존보다 학습이 훨씬 잘됨

- 간단한데 효과적

Dropout:

- 과적합 방지

- 일부 뉴런을 랜덤하게 끄기

Batch Normalization:

- 학습 안정화

- 더 깊게 쌓을 수 있음

이런 기법들로 수십, 수백 층도 가능해졌어요!

완벽한 타이밍

정리하면:

2010년대 이전:

- ❌ 데이터 부족

- ❌ 컴퓨터 느림

- ❌ 알고리즘 불완전

- → 딥러닝 실패

2010년대 이후:

- ✅ 빅데이터 (인터넷)

- ✅ GPU (게임 산업)

- ✅ 알고리즘 개선 (연구 발전)

- → 딥러닝 혁명! 🚀

요리 실력 향상 비유:

- 좋은 재료 (빅데이터)

- 좋은 도구 (GPU)

- 좋은 레시피 (알고리즘)

- = 훌륭한 요리 (딥러닝)

세 가지가 동시에 갖춰지니 폭발적으로 발전한 거예요!

딥러닝, AI 혁명의 시작

오늘 우리는 딥러닝의 세계를 탐험했습니다.

오늘 배운 핵심 내용

✅ 딥러닝 = 깊은 신경망

- 층이 많을수록 복잡한 학습

- 계층적으로 특징 추출

✅ CNN (이미지 전문가)

- 돋보기로 부분부분 확인

- 사진 인식, 얼굴 인식, 자율주행

✅ RNN (순서 전문가)

- 이전 정보를 기억

- 번역, 음성 인식, 챗봇

✅ 딥러닝의 3박자

- 빅데이터 (인터넷)

- GPU (게임 산업)

- 알고리즘 개선 (연구)

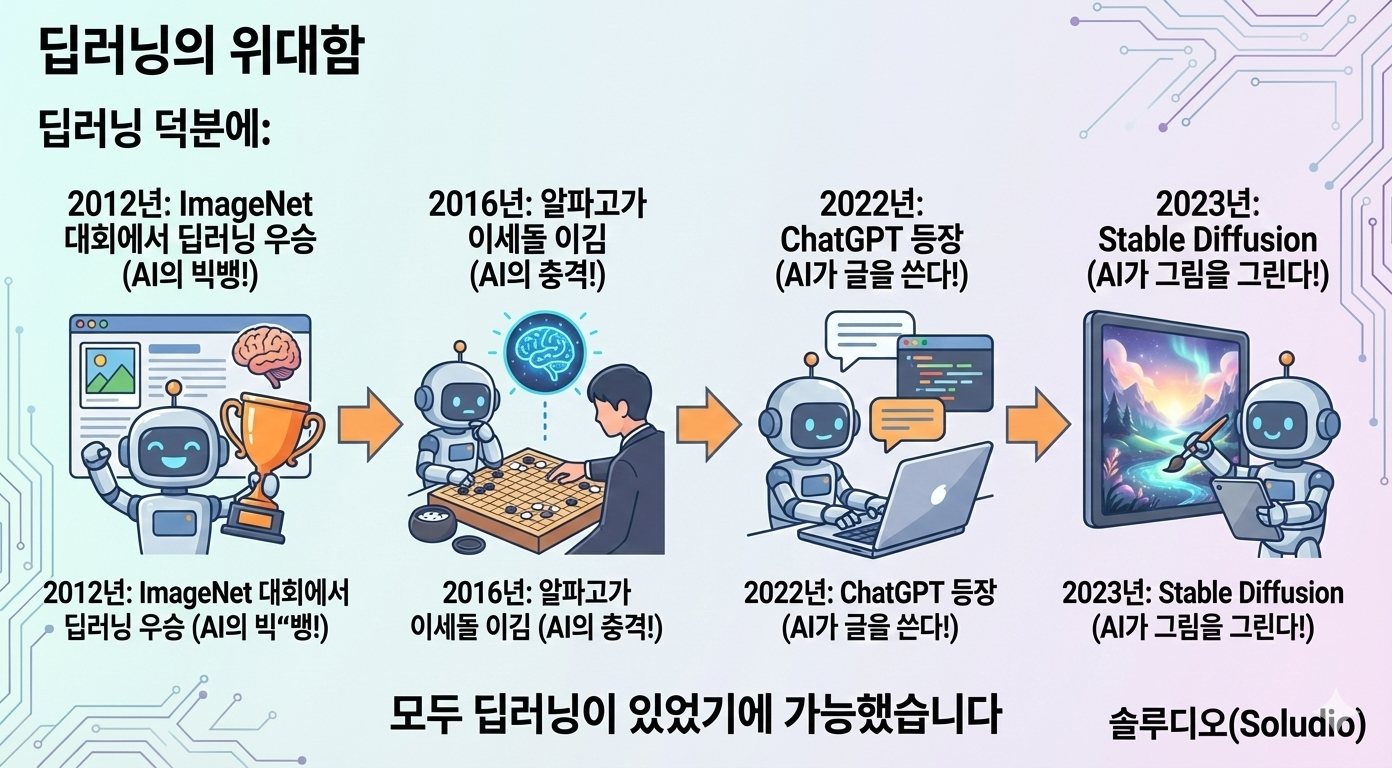

딥러닝의 위대함

딥러닝 덕분에:

2012년: ImageNet 대회에서 딥러닝 우승 (AI의 빅뱅!)

2016년: 알파고가 이세돌 이김 (AI의 충격!)

2022년: ChatGPT 등장 (AI가 글을 쓴다!)

2023년: Stable Diffusion (AI가 그림을 그린다!)

모두 딥러닝이 있었기에 가능했습니다.

다음 이야기

딥러닝이 뭔지는 알았는데...

"AI는 정확히 어떻게 똑똑해지는 거야?"

다음 글에서는 AI의 학습 원리를 자세히 알아보겠습니다:

- 손실 함수란?

- 경사하강법이란?

- AI가 실수를 줄이는 방법

딥러닝을 이해했으니, 이제 학습 과정을 배울 차례입니다!

'AI' 카테고리의 다른 글

| [AI 개념 정리 6] AI는 어떻게 똑똑해질까? 학습의 비밀 쉽게 이해하기(경사하강법, 에포크, 배치) (0) | 2025.11.27 |

|---|---|

| 구글 Antigravity(안티그래비티): 코딩의 중력을 거스르다! (개요, 특징, 설치법) (0) | 2025.11.27 |

| [AI 개념 정리 4] 인공 신경망(Neural Network)이란? 회사 조직 구조, 채용 결정 예시를 통해 AI 쉽게 이해하기(뉴런, 신경망) (1) | 2025.11.25 |

| [AI 개념 정리 3] AI 알고리즘 원리, 넷플릭스와 요리 레시피로 5분 만에 이해하기 (패턴인식, 의사결정트리) (0) | 2025.11.24 |

| [AI 개념 정리 2] AI는 어떻게 공부할까? 넷플릭스와 알파고로 배우는 머신러닝 원리 (0) | 2025.11.23 |