안녕하세요~ 솔루디오입니다^^

아기가 걷는 법을 배우는 과정을 본 적 있으신가요?

1단계: 일어서려다 넘어짐 😢

2단계: 한 걸음 걷다가 넘어짐

3단계: 두세 걸음 가다가 넘어짐

...반복...

N단계: 자연스럽게 걷기! 🎉

아기는 넘어질 때마다 "아, 이렇게 하면 안 되는구나"를 배웁니다. 사람은 본능적으로 배우는 것으로 조금씩 균형을 잡는 법을 터득하죠.

AI도 똑같습니다!

"진짜요? AI가 넘어지기도 해요?"

물론이죠! AI는 수백, 수천, 수만 번 실수하면서 배웁니다.

이전 글들에서 우리는 신경망과 딥러닝을 배웠습니다. 뉴런들이 층층이 쌓여서 정보를 처리하는 구조였죠. CNN은 이미지를 보고, RNN은 순서를 기억한다고 했어요. 사람으로 비유하면 뇌의 핵심 구조를 배운 것과 같은 거죠.

그런데 한 가지 궁금증이 남았을 겁니다:

"그래서 이런 구조를 가진 AI는 어떻게 똑똑해지는 거야?"

오늘은 바로 그 비밀, AI가 학습하는 원리를 알아보겠습니다!

오늘 공부할 내용이 좀 어렵고 많아서 정리를 해볼게요. 이 글을 다 읽고 나면:

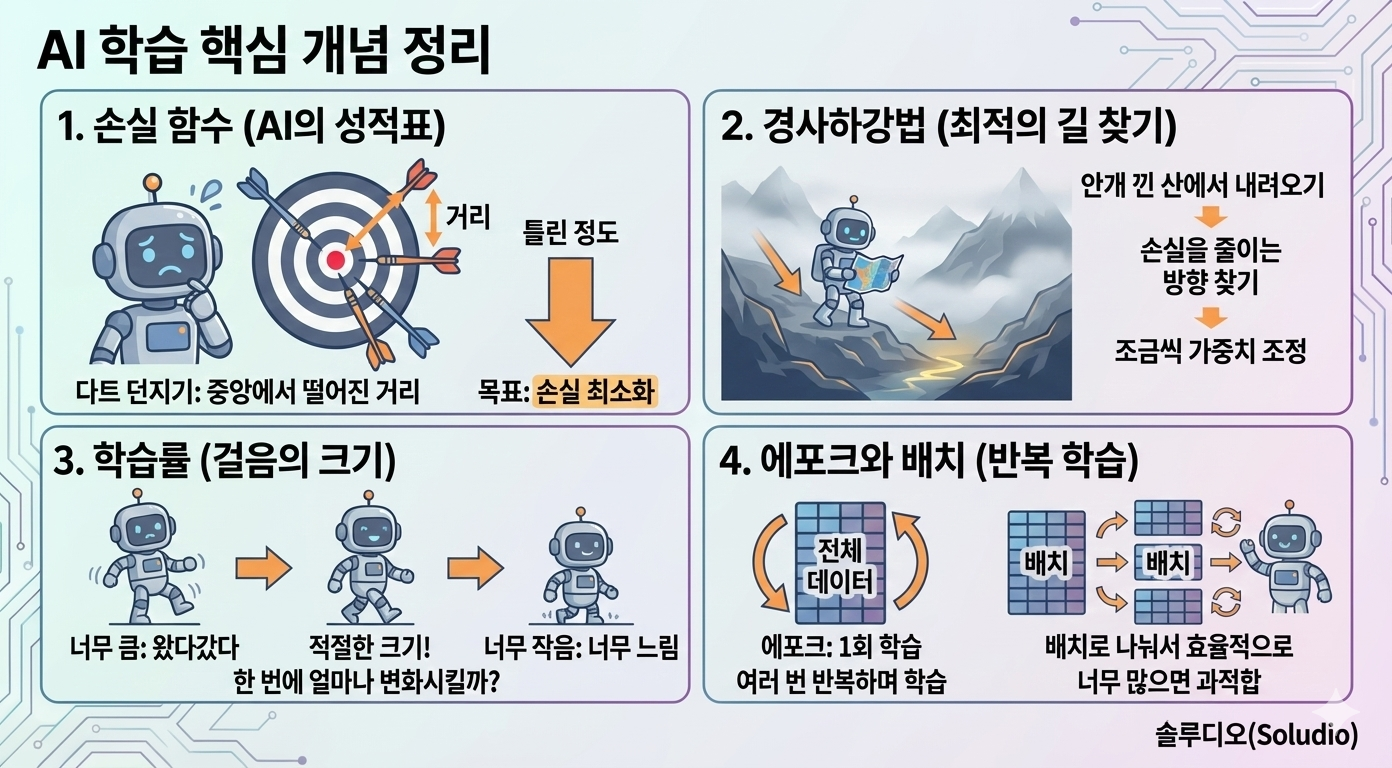

✅ 손실 함수가 뭔지 (AI의 성적표!)

✅ 경사하강법이 뭔지 (산 내려가는 것처럼!)

✅ 학습률의 중요성 (너무 크거나 작으면 안 돼요!)

✅ 에포크와 배치 (반복이 실력을 만들어요!)

모두 다트 던지기, 산 내려가기, 주차하기 같은 일상 예시로 설명해드릴게요.

자, 그럼 AI의 학습 과정 속으로 들어가볼까요? 📚

이전 글을 읽고 오시면 더 이해하기 좋아요^^

- [AI 개념 정리 5] 딥러닝이란? '딥'한 이유와 CNN, RNN 쉽게 이해하기

- [AI 개념 정리 4] 인공 신경망(Neural Network 이란? 회사 조직 구조, 채용 결정 예시를 통해 AI 쉽게 이해하기(뉴런, 신경망)

- [AI 개념 정리 3] AI 알고리즘 원리, 넷플릿스와 요리 레시피로 5분 만에 이해하기(패턴인식, 의사결정트리)

- [AI 개념 정리 2] AI는 어떻게 공부할까? 넷플릭스와 알파고로 배우는 머신러닝 원리

- [AI 개념 정리 1] AI 종류 완벽 정리: 약한 AI와 강한 AI 차이점은? (feat. ChatGPT)

손실 함수 - AI의 성적표

AI도 틀립니다

AI가 처음부터 완벽할까요?

절대 아닙니다!

갓 태어난 AI는 엉망진창이에요:

- 고양이 사진을 보고 "개!"

- 집값 3억인데 "5억이요!"

- "안녕하세요"를 듣고 "굿바이!"

완전히 틀리죠? 😅

그런데 AI는 자신이 얼마나 틀렸는지 측정할 수 있어요.

이게 바로 **손실 함수(Loss Function)**입니다!

다트 던지기 비유

다트 게임을 떠올려보세요.

목표: 정중앙 (정답)

내 다트: 중앙에서 30cm 떨어진 곳 (예측)

손실 = 30cm

이게 내가 얼마나 틀렸는지를 나타내는 숫자예요!

다시 던집니다:

- 1번째: 30cm 떨어짐 (손실 30)

- 2번째: 20cm 떨어짐 (손실 20) → 좋아졌네!

- 3번째: 10cm 떨어짐 (손실 10) → 더 좋아졌어!

- 4번째: 2cm 떨어짐 (손실 2) → 거의 완벽!

손실이 줄어들수록 실력이 늘어나는 거죠!

시험 점수 비유

더 쉬운 예를 들어볼게요.

목표: 100점 (만점)

내 점수: 70점

손실 = 100 - 70 = 30

다음 시험:

- 1차: 손실 30 (70점)

- 2차: 손실 20 (80점) → 실력 향상!

- 3차: 손실 10 (90점) → 더 좋아짐!

- 4차: 손실 5 (95점) → 거의 다 왔어!

손실이 작아질수록 목표에 가까워집니다!

AI의 손실 함수

AI도 똑같아요.

집값 예측 AI:

- 정답: 3억 2천만 원

- 예측: 3억 원

- 손실: 2천만 원

이미지 분류 AI:

- 정답: 고양이

- 예측: 고양이일 확률 60%

- 손실: 0.4 (1 - 0.6)

손실 함수는 "얼마나 틀렸는지"를 숫자로 표현합니다.

학습의 목표

AI 학습의 목표는 단순합니다:

손실을 최소화하자!

- 손실 큼 = 많이 틀림 = 나쁨

- 손실 작음 = 조금 틀림 = 좋음

- 손실 0 = 완벽! = 이상적

손실을 줄이는 게 바로 "학습"입니다!

경사하강법 - 최적의 길 찾기

그래서 어떻게 손실을 줄이죠?

"손실을 줄여야 한다는 건 알겠는데... 어떻게요?"

좋은 질문입니다! 여기서 등장하는 게 **경사하강법(Gradient Descent)**이에요.

이름이 어려워 보이지만, 원리는 엄청 단순합니다.

안개 낀 산에서 내려오기

상상해보세요.

여러분은 안개가 자욱한 산 정상에 있습니다.

목표: 산 아래로 내려가기 (손실 최소화)

문제: 앞이 안 보임

어떻게 할까요?

방법:

- 발밑을 더듬어본다

- "어느 쪽이 내리막인가?"

- 내리막 쪽으로 한 걸음

- 다시 발밑 확인

- 반복!

결국 산 아래에 도착하게 됩니다!

이게 바로 경사하강법이에요!

AI도 산을 내려갑니다

AI의 학습도 똑같습니다.

산 높이 = 손실 함수

산 아래 = 손실 최소

내려가기 = 학습

AI는:

- 현재 위치 확인 (현재 손실)

- 어느 방향이 내리막? (손실이 줄어드는 방향)

- 그 방향으로 한 걸음 (가중치 조정)

- 다시 확인

- 반복!

온도 조절 비유

에어컨 온도를 맞출 때를 생각해보세요.

목표: 적정 온도 22도

현재: 26도 (너무 더워!)

어떻게 할까요?

1단계: "26도? 너무 덥네, 낮춰야겠다"

→ 24도로 설정 (손실 감소!)

2단계: "24도? 아직 좀 덥네"

→ 23도로 설정 (더 감소!)

3단계: "23도? 거의 다 왔어"

→ 22도로 설정 (완벽!)

조금씩 목표에 가까워지는 거죠!

경사하강법의 핵심

정리하면:

- 현재 손실 확인

- "지금 얼마나 틀렸지?"

- 방향 찾기

- "어느 쪽으로 조정하면 손실이 줄어들까?"

- 조금 이동

- "그 방향으로 가중치를 조금 바꿔보자"

- 반복

- "더 나아질 수 있을 때까지 계속!"

이렇게 AI는 조금씩, 조금씩 똑똑해집니다.

학습률 - 걸음의 크기

한 번에 얼마나 움직일까?

경사하강법을 이해했으니, 이제 새로운 질문이 생깁니다.

"한 번에 얼마나 크게 변화시켜야 할까?"

너무 크게? 너무 작게?

이게 바로 **학습률(Learning Rate)**입니다!

목적지로 걷기

집에서 편의점까지 100m를 간다고 생각해보세요.

학습률이 너무 큰 경우 (한 걸음에 50m):

집 → 50m 앞 → 편의점 지나침! → 50m 뒤로 → 집으로 돌아옴!

→ 왔다갔다만 하고 영원히 도착 못 함 😭

학습률이 너무 작은 경우 (한 걸음에 10cm):

집 → 10cm → 20cm → 30cm → ...

→ 1000걸음 걸어야 도착, 너무 오래 걸림! 😫

학습률이 적절한 경우 (한 걸음에 5m):

집 → 5m → 10m → ... → 100m → 도착! 😊

→ 20걸음이면 도착, 딱 좋아!

주차하기 비유

주차할 때를 생각해보세요.

학습률 너무 큼 (악셀 세게):

- 앞으로 쭉! → 너무 앞으로 감

- 뒤로 쭉! → 너무 뒤로 감

- 앞뒤로 왔다갔다

- 위험하고 시간도 오래 걸림

학습률 너무 작음 (아주 조금씩):

- 앞으로 살짝...

- 뒤로 살짝...

- 10분 걸려 겨우 주차

- 안전하지만 너무 느림

학습률 적절 (적당히 조절):

- 빠르게 접근

- 가까워지면 천천히

- 안전하고 빠르게 주차!

볼륨 조절 비유

음악 볼륨을 50으로 맞추고 싶다고 해봅시다.

학습률 큼 (한 번에 10씩):

40 → 50 → 60 (너무 커!) → 50 → 60 (또 너무 커!)

→ 왔다갔다

학습률 작음 (한 번에 1씩):

40 → 41 → 42 → 43 → ... → 50

→ 10번이나 조절해야 함

학습률 적절 (한 번에 3씩):

40 → 43 → 46 → 49 → 50

→ 딱 4번 만에 완료!

AI의 학습률

AI도 학습률이 중요해요.

학습률이 너무 크면:

- 손실이 왔다갔다

- 최적점을 못 찾음

- 발산(Divergence)

학습률이 너무 작으면:

- 학습이 너무 느림

- 며칠, 몇 주 걸림

- 지역 최소값에 갇힘

학습률이 적절하면:

- 빠르고 정확하게 학습

- 최적점 도달

- Perfect! ✨

보통 0.001 ~ 0.01 사이를 많이 사용해요.

학습률 스케줄링

프로들은 더 똑똑하게 합니다.

처음엔 크게, 나중엔 작게!

마치 주차할 때처럼:

- 먼 거리: 빠르게 접근 (큰 학습률)

- 가까워지면: 천천히 조정 (작은 학습률)

이렇게 하면 빠르면서도 정확합니다!

에포크와 배치 - 반복 학습

한 번만 보면 될까요?

교과서를 딱 한 번만 읽고 시험 보면 어떻게 될까요?

망합니다! 😱

여러 번 반복해서 봐야 제대로 외워지죠.

AI도 똑같습니다. 데이터를 여러 번 반복해서 봐야 해요.

에포크(Epoch)란?

에포크 = 전체 데이터를 한 번 학습

예를 들어:

- 1 에포크: 교과서 1회독

- 5 에포크: 교과서 5회독

- 100 에포크: 교과서 100회독

교과서 공부 비유

1 에포크 (1회독):

- "아, 이런 내용이 있구나"

- 대충 이해

- 시험 보면? 60점

5 에포크 (5회독):

- "이제 좀 익숙하네"

- 대부분 이해

- 시험 보면? 85점

20 에포크 (20회독):

- "완전 달달 외웠어"

- 완벽하게 이해

- 시험 보면? 95점

100 에포크 (100회독):

- "교과서 내용을 글자 하나까지 외움"

- 하지만... 응용 문제는 못 풂!

- 시험 보면? 70점 (과적합!)

너무 많으면 문제!

교과서만 100번 외우면 무슨 일이 생길까요?

**과적합(Overfitting)**이 발생합니다!

- 교과서 내용: 완벽하게 암기

- 응용 문제: 전혀 못 풂

- 실전: 망함

AI도 똑같아요:

- 학습 데이터: 완벽하게 외움

- 새로운 데이터: 틀림

- 실전: 망함

배치(Batch)란?

배치 = 데이터를 나눠서 학습

전체 데이터를 한 번에 다 보는 게 아니라, 조금씩 나눠서 봐요.

운동 세트 비유

헬스장에서 운동할 때:

한 번에 다 하기 (배치 없음):

- 팔굽혀펴기 100개

- 스쿼트 100개

- 윗몸일으키기 100개

- → 중간에 지쳐서 못 함!

나눠서 하기 (배치 있음):

- 세트 1: 팔굽혀펴기 10개, 스쿼트 10개, 윗몸 10개

- 세트 2: 팔굽혀펴기 10개, 스쿼트 10개, 윗몸 10개

- ...반복...

- → 10세트 완료! 훨씬 효율적!

요리 연습 비유

요리책 100개 요리법을 배운다고 해봅시다.

한 번에 다 하기:

- 100개 요리를 한 번에 연습

- 머리 터짐

- 기억 안 남

배치로 나누기:

- 배치 1: 볶음 요리 10개 연습

- 배치 2: 조림 요리 10개 연습

- 배치 3: 구이 요리 10개 연습

- → 비슷한 것끼리 묶으니 배우기 쉬워!

배치의 장점

- 메모리 효율

- 전체를 한 번에 못 담을 때

- 조금씩 나눠서 처리

- 학습 안정성

- 조금씩 업데이트

- 급격한 변화 방지

- 일반화

- 다양한 샘플로 학습

- 과적합 방지

적절한 에포크 수

그럼 몇 번 반복해야 할까요?

정답은 없습니다!

하지만 보통:

- 간단한 문제: 10~50 에포크

- 복잡한 문제: 100~1000 에포크

- 아주 복잡한 문제: 수천 에포크

중요한 건 검증 데이터로 확인하는 거예요:

- 학습 손실: 계속 줄어듦

- 검증 손실: 어느 순간 올라감

- → 여기서 멈춰야 함! (Early Stopping)

학습, AI가 똑똑해지는 과정

오늘 우리는 AI 학습의 핵심을 배웠습니다.

오늘 배운 핵심 내용

✅ 손실 함수 (AI의 성적표)

- 얼마나 틀렸는지 측정

- 다트 던지기: 중앙에서 떨어진 거리

- 목표: 손실 최소화

✅ 경사하강법 (최적의 길 찾기)

- 손실을 줄이는 방향 찾기

- 안개 낀 산에서 내려오기

- 조금씩 가중치 조정

✅ 학습률 (걸음의 크기)

- 한 번에 얼마나 변화시킬까?

- 너무 크면 왔다갔다

- 너무 작으면 너무 느림

- 적절한 크기가 중요!

✅ 에포크와 배치 (반복 학습)

- 에포크: 전체 데이터 1회

- 여러 번 반복하며 학습

- 너무 많으면 과적합

- 배치로 나눠서 효율적으로

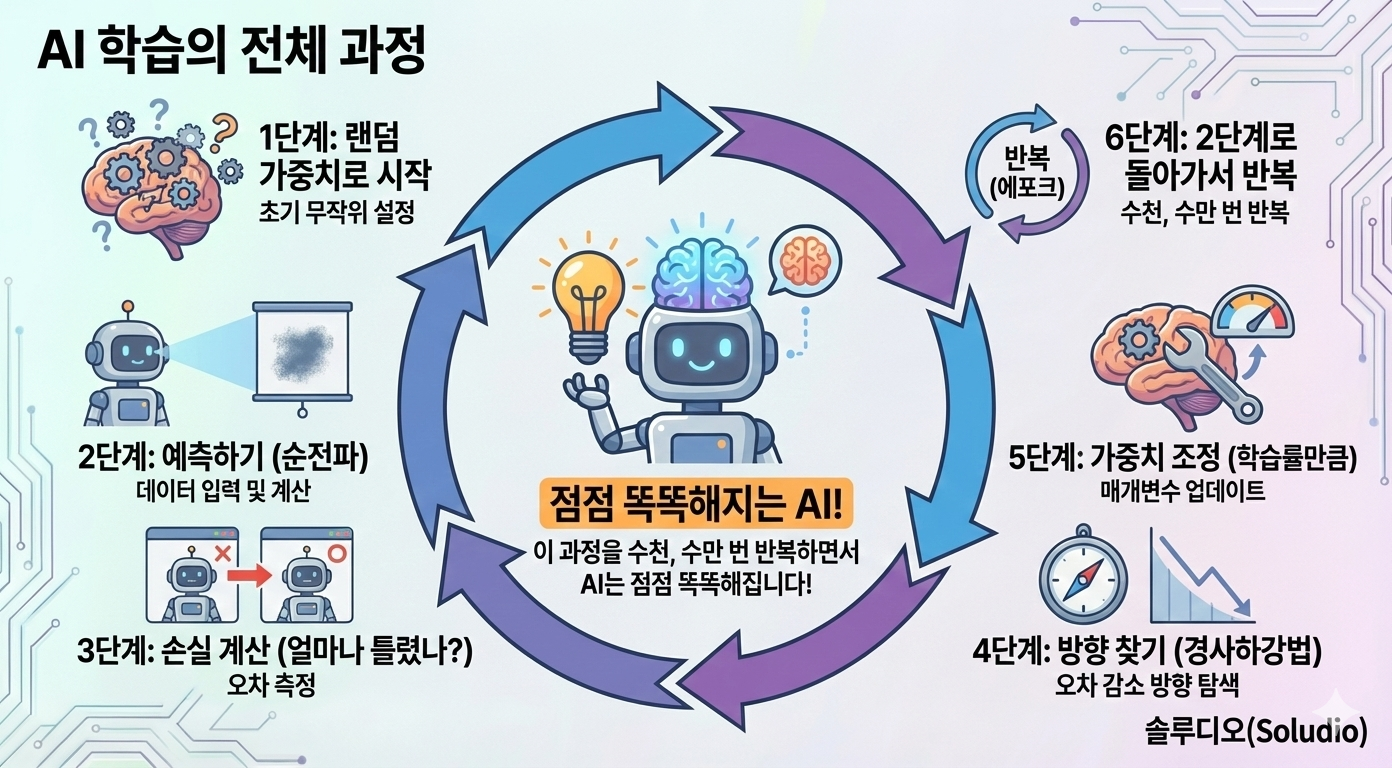

AI 학습의 전체 과정

정리하면 이렇습니다:

1단계: 랜덤 가중치로 시작

2단계: 예측하기 (순전파)

3단계: 손실 계산 (얼마나 틀렸나?)

4단계: 방향 찾기 (경사하강법)

5단계: 가중치 조정 (학습률만큼)

6단계: 2단계로 돌아가서 반복 (에포크)

이 과정을 수천, 수만 번 반복하면서 AI는 점점 똑똑해집니다!

마법이 아닌 과학

AI 학습은 마법이 아닙니다.

실수하고 → 측정하고 → 고치고 → 반복하기

아기가 걷는 법을 배우는 것처럼,

우리가 자전거 타는 법을 배우는 것처럼,

요리 실력이 늘어나는 것처럼,

AI도 똑같은 원리로 학습합니다!

다음 이야기

이제 AI가 어떻게 학습하는지 알았으니...

다음 글에서는 현대 AI의 혁명을 다룰 거예요:

- ChatGPT는 어떻게 작동할까?

- 트랜스포머가 뭐길래 그렇게 대단할까?

- Attention 메커니즘이란?

트랜스포머 모델이 나오면서 AI 시대가 이처럼 열린 거라 보시면 됩니다.

'AI' 카테고리의 다른 글

| "포토샵은 이제 끝?" 구글 나노 바나나 프로, 디자인의 판도를 뒤집다! (0) | 2025.11.29 |

|---|---|

| [AI 개념 정리 7] ChatGPT의 핵심, 트랜스포머란? Attention 메커니즘 쉽게 이해하기 (0) | 2025.11.28 |

| 구글 Antigravity(안티그래비티): 코딩의 중력을 거스르다! (개요, 특징, 설치법) (0) | 2025.11.27 |

| [AI 개념 정리 5] 딥러닝이란? '딥'한 이유와 CNN, RNN 쉽게 이해하기 (0) | 2025.11.26 |

| [AI 개념 정리 4] 인공 신경망(Neural Network)이란? 회사 조직 구조, 채용 결정 예시를 통해 AI 쉽게 이해하기(뉴런, 신경망) (1) | 2025.11.25 |