안녕하세요~ 솔루디오입니다^^

2016년 3월, 세계가 충격에 빠졌습니다.

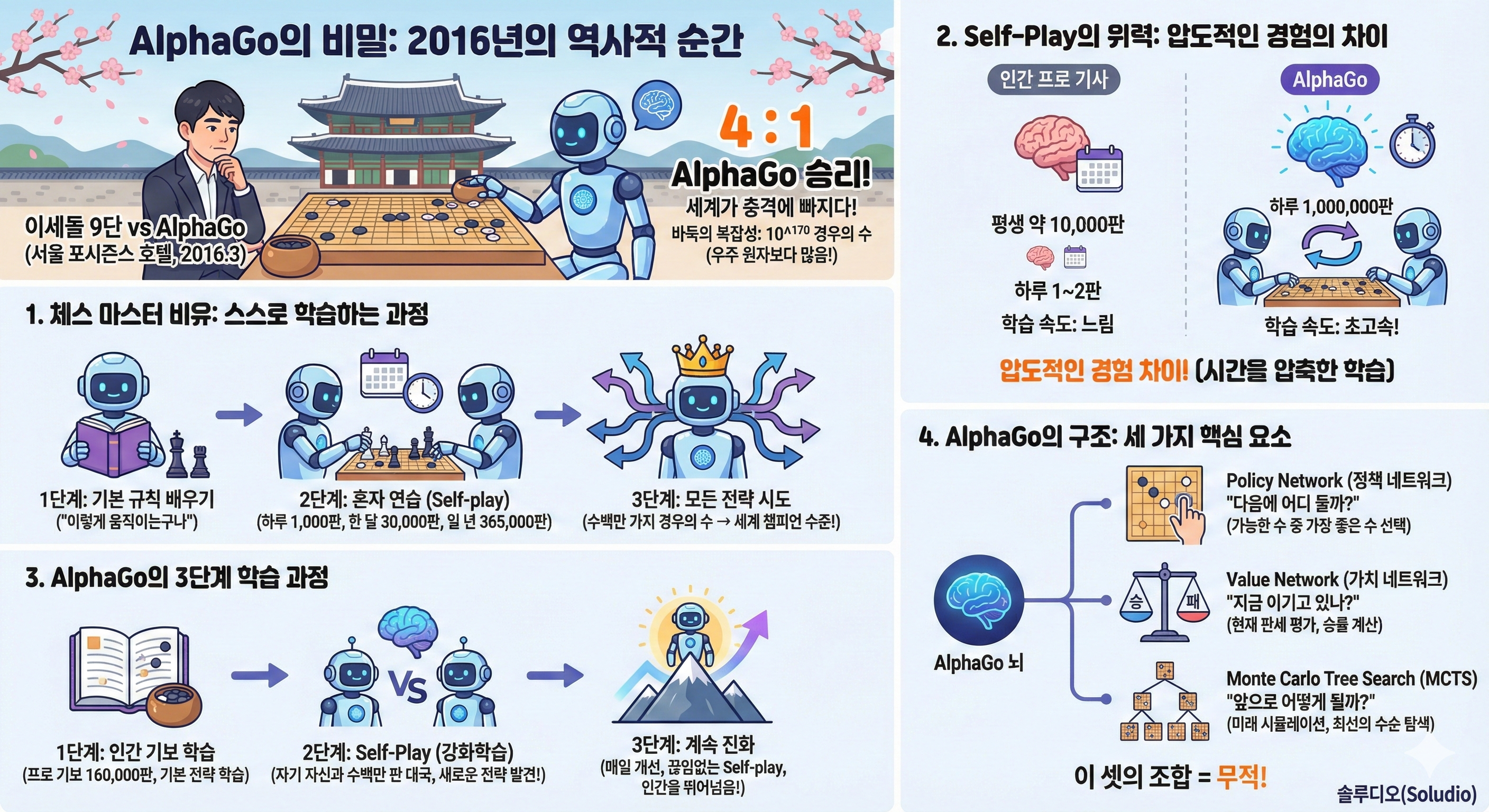

구글 DeepMind의 AlphaGo가 이세돌 9단을 이겼어요!

바둑은 인간만의 영역이라고 생각했는데...

AI가 세계 최고수를 4:1로 압도했습니다.

"어떻게 이게 가능해?"

정답은 바로 **강화학습(Reinforcement Learning)**이었어요.

이전 글을 읽고 오시면 더 이해하기 좋아요^^

- [AI 개념 정리 8] GPT, Claude는 어떻게 작용하나요? 대규모 언어 모델 쉽게 이해하기

- [AI 개념 정리 7] ChatGPT의 핵심, 트랜스포머란? Attention 메커니즘 쉽게 이해 하기

- [AI 개념 정리 6] AI는 어떻게 똑똑해질까? 학습의 비밀 쉽게 이해하기(경사하강법, 에포크, 배치)

- [AI 개념 정리 5] 딥러닝이란? '딥'한 이유와 CNN, RNN 쉽게 이해하기

- [AI 개념 정리 4] 인공 신경망(Neural Network 이란? 회사 조직 구조, 채용 결정 예시를 통해 AI 쉽게 이해하기(뉴런, 신경망)

- [AI 개념 정리 3] AI 알고리즘 원리, 넷플릿스와 요리 레시피로 5분 만에 이해하기(패턴인식, 의사결정트리)

- [AI 개념 정리 2] AI는 어떻게 공부할까? 넷플릭스와 알파고로 배우는 머신러닝 원리

- [AI 개념 정리 1] AI 종류 완벽 정리: 약한 AI와 강한 AI 차이점은? (feat. ChatGPT)

혼자서 배우는 AI

지난 글들에서 우리는 신경망, 딥러닝, 트랜스포머, LLM, 생성형 AI를 배웠어요.

그런데 강화학습은 다릅니다!

지금까지 배운 AI들:

- 데이터를 보고 배움

- 정답을 알려줘야 함

- 사람의 도움 필요

강화학습:

- 스스로 시도하며 배움

- 정답을 모름

- 혼자서 마스터!

마치 강아지가 훈련받듯이, AI도 보상과 처벌로 배워요! 🐕

오늘 여러분이 배울 것들

이 글을 다 읽고 나면:

✅ 강화학습이 뭔지 (시행착오 학습!)

✅ 보상과 처벌의 원리 (당근과 채찍!)

✅ AlphaGo의 비밀 (Self-play!)

✅ 실제 활용 사례 (게임부터 자율주행까지!)

모두 강아지 훈련, 자전거 타기, 미로 찾기 같은 일상 예시로 설명해드릴게요.

자, 그럼 AI가 스스로 학습하는 세계로 들어가볼까요? 🎮

강화학습이란? 시행착오의 학습

Reinforcement Learning

Reinforcement를 한글로 하면 **"강화"**예요.

Reinforcement Learning = 강화학습 = 시행착오로 배우는 학습

강아지 훈련하기

강화학습을 가장 잘 설명하는 예시:

강아지에게 "앉기" 가르치기

시도 1: "앉아!"

강아지: 멍하니 서있음

주인: 아무 반응 없음

시도 2: "앉아!"

강아지: 우연히 앉음

주인: "잘했어!" + 간식 🦴

강아지: "오! 이게 정답이구나!"

시도 3: "앉아!"

강아지: 바로 앉음 (학습 완료!)

주인: 간식! 🦴간식(보상)을 받으니까 반복하게 돼요!

아기가 걷기 배우기

인간도 강화학습으로 배웁니다:

단계 1: 일어서기 시도

결과: 넘어짐 😢

배운 것: 이 방법은 안 됨

단계 2: 다시 일어서기

결과: 2초간 버팀!

보상: 부모님 박수 👏

배운 것: 이 자세가 좋음

단계 3: 한 발 내딛기

결과: 또 넘어짐 😢

배운 것: 균형 필요

...수백 번 반복...

최종: 걷기 마스터! 🎉

보상: 엄청난 기쁨!실패와 성공을 반복하며 배워요!

지도학습 vs 강화학습

차이를 명확하게 비교하면:

지도학습 (Supervised Learning):

선생님: "이 사진은 고양이야"

AI: "네, 고양이입니다"

선생님: "이건 강아지야"

AI: "네, 강아지입니다"

→ 정답을 알려줌

→ AI는 따라 배움강화학습 (Reinforcement Learning):

AI: "이게 고양이인가?" (시도)

환경: "틀렸어" (-10점)

AI: "그럼 강아지?" (다시 시도)

환경: "맞아!" (+100점)

→ 정답을 안 알려줌

→ AI가 스스로 찾음핵심 요소 4가지

강화학습의 4대 구성 요소:

1. Agent (에이전트):

학습하는 주체

예: AI, 로봇, 게임 플레이어

"내가 뭘 해야 하지?"2. Environment (환경):

상호작용하는 공간

예: 게임 화면, 도로, 바둑판

"여기가 내 세상이야"3. Action (행동):

선택 가능한 행동

예: 앞으로, 뒤로, 점프, 바둑돌 놓기

"이걸 해볼까?"4. Reward (보상):

행동에 대한 피드백

예: +10점, -5점, 승리(+100), 패배(-100)

"잘했어!" or "실패!"학습 과정

강화학습의 싸이클:

1. 상황 관찰

"지금 상황이 이래"

2. 행동 선택

"이렇게 해볼까?"

3. 행동 실행

"해보자!"

4. 보상 받기

"+10점!" or "-5점"

5. 학습

"아하! 이 상황엔 이 행동이 좋구나"

6. 반복

"다음 상황은?"수천, 수만 번 반복하면 마스터!

보상과 처벌의 메커니즘

Reward = 점수

강화학습의 핵심은 **보상(Reward)**이에요.

보상이 높으면 → 그 행동을 반복

보상이 낮으면 → 그 행동을 회피

간단하죠?

미로 찾기

미로 탈출 게임을 생각해보세요:

출구를 향해 이동

→ 올바른 방향: +10점

→ 막다른 길: -5점

→ 벽에 부딪힘: -10점

→ 출구 도달: +100점!

AI가 처음엔 헤매지만...

점점 최적 경로를 학습해요!초반 (경험 없음):

→ → ↓ ← ↑ → (헤맴)

점수: -30점

"이건 아닌데..."중반 (경험 쌓임):

→ → ↓ → (좀 나음)

점수: +20점

"조금 나아졌어"후반 (마스터):

→ ↓ → → (최적 경로!)

점수: +100점

"완벽해!" ✨식당 찾기

일상 예시로 보면:

주변 식당 탐험:

A 식당:

첫 방문 → 맛있음!

보상: +10 (만족감)

→ 다시 방문 ✅

B 식당:

첫 방문 → 별로...

보상: -5 (실망)

→ 안 감 ❌

C 식당:

첫 방문 → 최고!

보상: +20 (강력 만족)

→ 단골됨 ✅✅경험이 쌓이면 최고의 식당만 가게 돼요!

직장인의 업무

회사에서도 마찬가지:

방법 A로 업무:

결과: 성과 좋음

보상: 칭찬 + 승진 (+100)

→ 계속 이 방법 사용 ✅

방법 B로 업무:

결과: 성과 나쁨

보상: 피드백 (-20)

→ 이 방법 중단 ❌경험을 통해 최적의 방법을 터득!

Exploration vs Exploitation

강화학습의 딜레마:

Exploration (탐험):

새로운 것 시도

"이 식당도 가볼까?"

→ 더 좋은 선택 발견 가능

→ 하지만 위험 (실패 가능)Exploitation (활용):

아는 것 활용

"늘 가던 식당으로"

→ 안전함 (실패 없음)

→ 하지만 더 나은 선택 놓침균형이 중요해요!

초반: 탐험 많이 (80% 탐험, 20% 활용)

중반: 균형 (50% 탐험, 50% 활용)

후반: 활용 많이 (20% 탐험, 80% 활용)

Q-Learning

Q = Quality (품질, 가치)

각 행동의 가치를 표로 만들어요:

상황 A에서:

- 행동 1: Q값 = 10 (좋음)

- 행동 2: Q값 = -5 (나쁨)

- 행동 3: Q값 = 20 (최고!)

→ 행동 3을 선택!경험이 쌓일수록 Q값이 정확해져요.

Policy (정책)

Policy = 행동 지침

"이 상황에선 이렇게 해!"

배고플 때 → 식당 가기

졸릴 때 → 자기

위험할 때 → 피하기

기회 왔을 때 → 잡기학습의 최종 결과물 = 최적의 Policy!

AlphaGo의 비밀

2016년, 역사적 순간

2016년 3월 9일 ~ 15일

장소: 서울 포시즌스 호텔

대결: 이세돌 9단 vs AlphaGo

결과: 4:1 AlphaGo 승리

세계가 충격에 빠졌습니다!

바둑은 인간의 마지막 보루였어요:

- 가능한 경우의 수: 10^170 (우주 원자 수보다 많음!)

- 직관과 창의성 필요

- 컴퓨터가 이길 수 없다고 생각

하지만 AlphaGo가 해냈어요!

체스 마스터 되기

AlphaGo를 이해하려면:

혼자서 체스 마스터 되기:

1단계: 기본 규칙 배우기

"이렇게 움직이는구나"

2단계: 혼자 연습 (Self-play)

"나 vs 나"

하루 1,000판

한 달 30,000판

일 년 365,000판

3단계: 모든 전략 시도

"이렇게 하면?"

"저렇게 하면?"

수백만 가지 경우의 수

최종: 세계 챔피언 수준!AlphaGo도 똑같이 했어요!

Self-Play의 위력

Self-Play = 자기 자신과 대국

AlphaGo vs AlphaGo

AlphaGo vs AlphaGo

AlphaGo vs AlphaGo

...수백만 번 반복...인간 vs AI 경험량 비교:

인간 프로 바둑기사:

- 평생: 약 10,000판

- 하루: 1~2판

- 학습 속도: 느림

AlphaGo:

- 하루: 1,000,000판

- 한 달: 3천만 판

- 학습 속도: 초고속!압도적인 경험 차이!

요리 마스터 비유

레스토랑 셰프가 되려면:

일반 셰프:

- 하루 10접시

- 1년 3,650접시

- 10년 36,500접시

AI 셰프:

- 하루 10,000접시

- 1년 365만 접시

- 1년 만에 인간의 100년 경험!시간을 압축한 거예요!

AlphaGo의 3단계 학습

1단계: 인간 기보 학습

프로 기사들의 기보 160,000판

"인간은 이렇게 두는구나"

기본 전략 학습2단계: Self-Play (강화학습!)

자기 자신과 수백만 판 대국

"이렇게 두면 이기네?"

"저렇게 두면 지네"

새로운 전략 발견!3단계: 계속 진화

매일 개선

끊임없는 Self-play

인간을 뛰어넘음AlphaGo의 구조

Policy Network (정책 네트워크):

"다음에 어디 둘까?"

가능한 수 중 가장 좋은 수 선택

수백만 번 경험으로 학습Value Network (가치 네트워크):

"지금 이기고 있나?"

현재 판세 평가

승률 계산Monte Carlo Tree Search:

"앞으로 어떻게 될까?"

미래 시뮬레이션

최선의 수순 탐색이 셋의 조합 = 무적!

강화학습의 실제 활용

게임 AI의 혁명

Dota 2 - OpenAI Five (2018):

5 vs 5 팀 게임

프로게이머 팀 vs AI 팀

결과: AI 승리!StarCraft II - AlphaStar (2019):

실시간 전략 게임

프로게이머 vs AI

결과: AI가 그랜드마스터 달성!게임은 강화학습의 실험실이에요!

로봇 팔 훈련

로봇이 물건 잡기:

시도 1: 실패 (떨어뜨림)

보상: -10점

"이 각도는 안 되네"

시도 100: 가끔 성공

보상: +20점

"이 방법이 좋은 것 같아"

시도 10,000: 완벽 성공

보상: +100점

"완전히 마스터했어!" ✨실제 로봇 공장에서 사용 중!

자율주행차

Tesla, Waymo 등의 자율주행:

시뮬레이션 주행:

- 안전 운전: +10점

- 차선 이탈: -20점

- 사고: -100점

- 목적지 도착: +100점

수백만 km 가상 주행

→ 안전 운전 마스터!실제 도로보다 시뮬레이션이 안전해요!

로봇 걷기

보스턴 다이내믹스의 로봇:

초반: 넘어지기만 함

중반: 비틀거리며 걷기

후반: 뛰고, 점프하고, 백플립!

강화학습으로 학습:

- 균형 잡기: +10

- 앞으로 진행: +20

- 넘어짐: -50

- 목표 도달: +100이제 인간처럼 움직여요!

YouTube 추천

YouTube가 영상 추천하는 원리:

영상 A 추천:

사용자: 끝까지 시청 ✅

보상: +10점

"이런 영상 더 추천!"

영상 B 추천:

사용자: 5초 보고 닫음 ❌

보상: -5점

"이런 영상은 빼자"

...수십억 번 반복...

결과: 개인 맞춤 추천!

"이 사람은 이런 걸 좋아하네"중독성 있는 이유가 강화학습!

산업용 로봇

공장 자동화:

조립 작업:

- 정확한 위치: +10

- 빠른 속도: +5

- 실수: -20

- 완벽한 제품: +100

24시간 학습

→ 인간보다 정확하고 빠름금융 트레이딩

주식 자동 매매:

매수 판단:

- 수익 발생: +수익금액

- 손실 발생: -손실금액

수백만 번 시뮬레이션

→ 최적의 전략 학습하지만 100% 보장은 없어요!

강화학습, AI의 자율성

오늘 우리는 스스로 학습하는 AI의 비밀을 배웠습니다.

오늘 배운 핵심 내용

✅ 강화학습

- 시행착오로 학습

- 보상과 처벌이 핵심

- 스스로 마스터

- 정답을 알려주지 않음

✅ 보상 메커니즘

- Agent, Environment, Action, Reward

- Exploration vs Exploitation

- Q-Learning, Policy

- 경험이 쌓이며 개선

✅ AlphaGo

- 딥러닝 + 강화학습

- Self-play의 위력

- 2016년 이세돌 4:1 승리

- AI 시대의 상징

✅ 실제 활용

- 게임 AI (Dota, StarCraft)

- 로봇 제어 (걷기, 잡기)

- 자율주행 (Tesla, Waymo)

- 추천 시스템 (YouTube, Netflix)

강화학습의 특별함

다른 AI와의 차이:

지도학습: "선생님이 가르쳐줌"

비지도학습: "패턴을 스스로 찾음"

강화학습: "직접 해보며 배움"강화학습이 특별한 이유:

- 정답이 없는 문제 해결

- 창의적인 전략 발견

- 인간을 뛰어넘는 성능

- 자율성!

한계도 있어요

강화학습의 어려움:

❌ 엄청난 시간 필요

→ 수백만 번 시도해야 함

❌ Reward 설계 어려움

→ 잘못 설계하면 이상한 행동

❌ 실제 환경 적용 위험

→ 시뮬레이션과 현실의 차이

❌ 비용이 많이 듦

→ 컴퓨팅 파워 필요

하지만 계속 발전하고 있어요!

다음 이야기

게임을 정복한 강화학습을 배웠으니...

AI를 제대로 활용하는 방법은 어떨까요?

다음 글에서는 프롬프트 엔지니어링에 대해 알아보겠습니다:

- AI와 효과적으로 대화하는 법

- 좋은 프롬프트 vs 나쁜 프롬프트

- 실전 프롬프트 작성 기술

이론에서 실전으로, Phase 4가 시작됩니다!

강화학습을 이해하면 AI의 자율성이 보입니다! 🎮

'AI' 카테고리의 다른 글

| [프롬프트 엔지니어링 실전편] "글 써줘"는 이제 그만! 복사만 하면 되는 상황별 프롬프트 템플릿 14개 (0) | 2025.12.12 |

|---|---|

| [AI 개념 정리 10] 프롬프트 엔지니어링이란? 이것만 이해를 하세요 (0) | 2025.12.11 |

| AI 자동화 도구, 뭘 써야 할까? 초보자를 위한 4가지 선택지 완전 비교(Opal vs n8n vs Make vs Agent builder) (0) | 2025.12.07 |

| [AI 개념 정리 8] GPT, Claude는 어떻게 작동하나요? 대규모 언어 모델 쉽게 이해하기 (0) | 2025.12.02 |

| "포토샵은 이제 끝?" 구글 나노 바나나 프로, 디자인의 판도를 뒤집다! (0) | 2025.11.29 |