안녕하세요~ 솔루디오입니다^^

"AI 모델 하나 만드는데 얼마나 걸려요?"

답변: 보통 수개월, 비용은 수억 원...

😱 "헉! 그럼 우리는 못 만드는 건가요?"

아니요! 방법이 있습니다!

처음부터 배울 필요 없어요

운전 초보를 떠올려보세요:

처음 배우는 사람:

도로교통법 공부: 1개월

운전 이론: 1개월

기능 연습: 1-2개월

도로 주행: 2-3개월

총 6개월 ⏰이미 운전할 줄 아는 사람:

기본 운전 OK ✅

새 차 적응: 1주일

특수 차량 (트럭): 1개월 추가

총 1개월 ⏰6개월 vs 1개월!

AI도 똑같아요!

지식을 재사용하는 기술

지난 글에서 AI 평가 방법을 배웠어요. 좋은 AI와 나쁜 AI를 구별하는 법이죠.

이번엔 효율적으로 AI를 만드는 방법입니다!

처음부터 학습하지 말고, 기존 지식을 활용하세요.

마치:

- 자전거 → 오토바이 🏍️

- 영어 → 스페인어 🌍

- 피아노 → 오르간 🎹

기초는 그대로, 새로운 것만 배우기!

이전 글을 읽고 오시면 더 이해하기 좋아요^^

- [AI 개념 정리 11] 좋은 AI vs 나쁜 AI, 모델 평가 방법 쉽게 이해하기

- [AI 개념 정리 10] 프롬프트 엔지니어링이란? 이것만 이해를 하세요

- [AI 개념 정리 9] 게임을 정복한 AI, 강화학습이란? AlphaGo 쉽게 이해하기

- [AI 개념 정리 8] GPT, Claude는 어떻게 작용하나요? 대규모 언어 모델 쉽게 이해하기

- [AI 개념 정리 7] ChatGPT의 핵심, 트랜스포머란? Attention 메커니즘 쉽게 이해 하기

- [AI 개념 정리 6] AI는 어떻게 똑똑해질까? 학습의 비밀 쉽게 이해하기(경사하강법, 에포크, 배치)

- [AI 개념 정리 5] 딥러닝이란? '딥'한 이유와 CNN, RNN 쉽게 이해하기

- [AI 개념 정리 4] 인공 신경망(Neural Network 이란? 회사 조직 구조, 채용 결정 예시를 통해 AI 쉽게 이해하기(뉴런, 신경망)

- [AI 개념 정리 3] AI 알고리즘 원리, 넷플릿스와 요리 레시피로 5분 만에 이해하기(패턴인식, 의사결정트리)

- [AI 개념 정리 2] AI는 어떻게 공부할까? 넷플릭스와 알파고로 배우는 머신러닝 원리

- [AI 개념 정리 1] AI 종류 완벽 정리: 약한 AI와 강한 AI 차이점은? (feat. ChatGPT)

오늘 여러분이 배울 것들

이 글을 다 읽고 나면:

✅ 전이학습이 뭔지 (지식의 재사용!)

✅ Feature Extraction vs Fine-tuning

✅ 실전 활용 사례

✅ 장점과 한계

모두 의대생, 요리사, 집 리모델링 같은 실생활 예시로 설명해드릴게요.

자, 그럼 효율적인 AI 개발의 비밀을 배워볼까요? 🚀

전이학습이란? 지식의 재사용

Transfer Learning의 핵심

Transfer Learning (전이학습) = 배운 지식을 새 분야로 옮기기

기존 지식 + 새 지식 = 빠른 학습!자전거에서 오토바이로

자전거를 탈 줄 아는 사람이 오토바이를 배울 때:

처음부터 배우는 사람:

균형 잡기: 1개월

페달 밟기: 2주

핸들 조작: 2주

브레이크: 1주

가속: 1주

총 2개월 ⏰자전거 탈 줄 아는 사람:

균형 잡기: 이미 알음 ✅

핸들 조작: 이미 알음 ✅

가속 배우기: 1주

브레이크 배우기: 1주

총 2주 ⏰2개월 vs 2주!

기초 능력을 재사용했어요!

영어에서 스페인어로

영어를 아는 사람이 스페인어를 배울 때:

처음 언어를 배우는 사람:

알파벳: 1개월

문법 개념: 3개월

단어: 6개월

회화: 6개월

총 16개월 ⏰영어를 아는 사람:

알파벳: 비슷함 (1주)

문법 개념: 이미 이해함 ✅

단어: 유사한 것 많음 (3개월)

회화: (3개월)

총 7개월 ⏰16개월 vs 7개월!

피아노에서 오르간으로

피아노를 칠 줄 아는 사람이 오르간을 배울 때:

처음 악기를 배우는 사람:

음감: 6개월

리듬감: 6개월

손가락 기술: 1년

악보 읽기: 6개월

총 2년 6개월 ⏰피아노를 치는 사람:

음감: 있음 ✅

리듬감: 있음 ✅

손가락 기술: 있음 ✅

악보 읽기: 할 줄 앎 ✅

페달 사용법만: 2개월

총 2개월 ⏰2년 6개월 vs 2개월!

요리사의 전문화

일반 요리를 할 줄 아는 사람이 파스타 전문가가 될 때:

요리 초보:

칼질: 3개월

불 조절: 2개월

양념 배합: 3개월

타이밍: 2개월

파스타 레시피: 2개월

총 1년 ⏰요리사:

기본 기술: 있음 ✅

파스타 레시피만: 2개월

총 2개월 ⏰1년 vs 2개월!

AI 전이학습

전통적 AI 학습:

데이터 수집: 수백만 장

학습 시간: 수주~수개월

GPU 비용: 수천만~수억 원

결과: 좋은 모델 ✅전이학습:

기존 모델: 있음 ✅

새 데이터: 수백~수천 장

학습 시간: 수시간~수일

GPU 비용: 수백만~수천만 원

결과: 좋은 모델 ✅수개월 vs 수일!

왜 가능할까?

AI가 이미지를 볼 때 배우는 것:

초기 층:

선 감지

곡선 감지

점 감지

→ 모든 이미지에 공통!중간 층:

형태 감지

패턴 감지

질감 감지

→ 대부분 이미지에 공통!마지막 층:

"이건 고양이"

"이건 강아지"

→ 작업마다 다름!전이학습 전략:

초기+중간 층: 재사용 ✅ (이미 훈련됨)

마지막 층만: 새로 학습 🆕효율적이죠!

전이학습의 두 가지 방법

방법 1: Feature Extraction (특징 추출)

"교과서 그대로 사용하기"

의대생이 전문 분야 공부할 때:

기초 의학 교과서: 그대로 사용 📚

전문 분야 교재만: 새로 추가 🆕

장점:

- 빠름 ⏰

- 안전 ✅

- 쉬움 😊

단점:

- 완벽하지 않을 수 있음 ⚠️AI에서:

사전학습 모델: 동결 (Freeze) ❄️

새 층만: 학습 🆕

학습 시간: 수시간

필요 데이터: 수백 장

정확도: 80~90%방법 2: Fine-tuning (미세 조정)

"교과서를 약간 수정하기"

의대생이 전문 분야에 맞게:

기초 의학 교과서: 일부 수정 📝

전문 분야 교재: 추가 🆕

기초 지식도: 약간 조정 🔧

장점:

- 더 정확 ✅

- 최적화됨 ✅

단점:

- 시간 필요 ⏰

- 데이터 더 필요 📊AI에서:

사전학습 모델: 일부 해동 (Unfreeze) 🔥

전체 또는 일부: 재학습 🔧

학습 시간: 수일

필요 데이터: 수천 장

정확도: 90~95%집 리모델링으로 비유하기

Feature Extraction = 인테리어만 바꾸기:

뼈대 (기둥, 벽): 그대로 🏗️

인테리어: 새로 꾸미기 🎨

기간: 1주일

비용: 500만 원

결과: 빠르고 저렴 ✅Fine-tuning = 구조도 조정하기:

뼈대: 일부 수정 🔨

인테리어: 새로 꾸미기 🎨

전체 조화: 최적화 ✨

기간: 1개월

비용: 2000만 원

결과: 완벽한 맞춤 ✅요리 레시피로 비유하기

Feature Extraction = 레시피 그대로:

기본 레시피: 그대로 📋

토핑만: 바꾸기 🍕

예: 마르게리타 피자 → 페퍼로니 피자

시간: 10분 추가

결과: 빠르고 쉬움 ✅Fine-tuning = 레시피 응용:

기본 레시피: 약간 수정 📝

양념, 조리법: 조정 🔧

예: 이탈리아 피자 → 한국식 피자

시간: 30분 추가

결과: 더 맛있지만 노력 필요 ✅어떤 방법을 선택할까?

상황별 선택 가이드:

✅ Feature Extraction을 선택:

- 데이터가 적음 (수백 장)

- 빠른 결과 필요

- 새 작업이 기존과 비슷함

- 리소스 제한

✅ Fine-tuning을 선택:

- 데이터가 충분 (수천 장)

- 최고 성능 필요

- 새 작업이 기존과 다름

- 시간 여유 있음

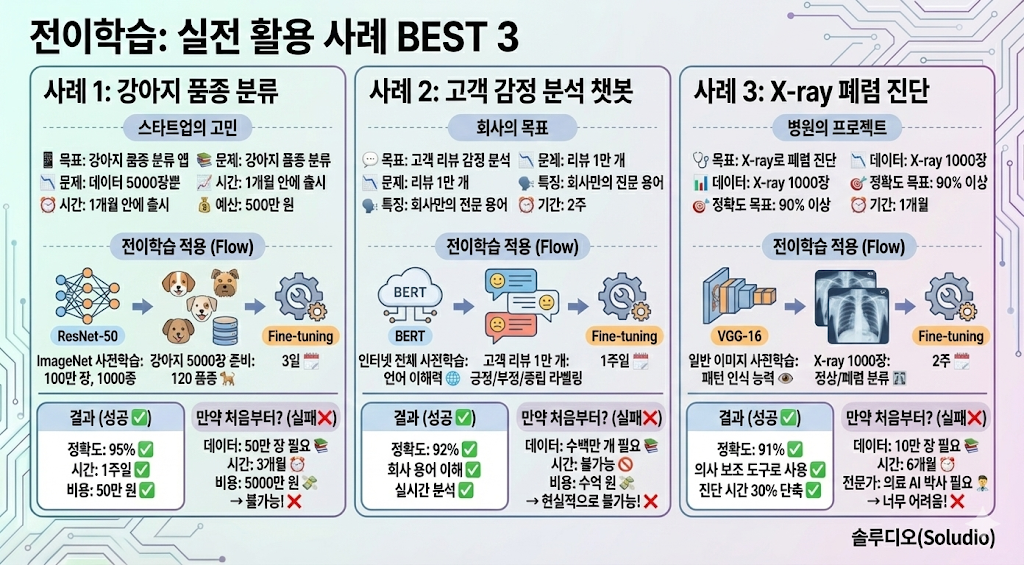

실전 활용 사례

사례 1: 강아지 품종 분류

스타트업의 고민:

목표: 강아지 품종 분류 앱

문제: 데이터 5000장뿐

시간: 1개월 안에 출시

예산: 500만 원전이학습 적용:

1단계: ResNet-50 선택

(ImageNet으로 사전학습)

100만 장, 1000종 학습됨 ✅

2단계: 강아지 5000장 준비

120 품종

3단계: Fine-tuning 3일

결과:

정확도: 95% ✅

시간: 1주일 ✅

비용: 50만 원 ✅만약 처음부터?

데이터: 50만 장 필요

시간: 3개월

비용: 5000만 원

→ 불가능! ❌사례 2: 고객 감정 분석 챗봇

회사의 목표:

목표: 고객 리뷰 감정 분석

문제: 리뷰 1만 개

특징: 회사만의 전문 용어

기간: 2주전이학습 적용:

1단계: BERT 선택

(인터넷 전체로 사전학습)

언어 이해력 있음 ✅

2단계: 고객 리뷰 1만 개

긍정/부정/중립 라벨링

3단계: Fine-tuning 1주일

결과:

정확도: 92% ✅

회사 용어 이해 ✅

실시간 분석 ✅만약 처음부터?

데이터: 수백만 개 필요

시간: 불가능

비용: 수억 원

→ 현실적으로 불가능! ❌사례 3: X-ray 폐렴 진단

병원의 프로젝트:

목표: X-ray로 폐렴 진단

데이터: X-ray 1000장

정확도 목표: 90% 이상

기간: 1개월전이학습 적용:

1단계: VGG-16 선택

(일반 이미지로 사전학습)

패턴 인식 능력 ✅

2단계: X-ray 1000장

정상/폐렴 분류

3단계: Fine-tuning 2주

결과:

정확도: 91% ✅

의사 보조 도구로 사용 ✅

진단 시간 30% 단축 ✅만약 처음부터?

데이터: 10만 장 필요

시간: 6개월

전문가: 의료 AI 박사 필요

→ 너무 어려움! ❌실전 프로세스 5단계

전이학습 실전 가이드:

1단계: 사전학습 모델 선택

- 유사한 작업에서 학습된 모델

- 이미지: ResNet, VGG, EfficientNet

- 텍스트: BERT, GPT, RoBERTa

2단계: 데이터 준비

- 수백~수천 개면 충분

- 품질이 중요

- 라벨 정확하게

3단계: Fine-tuning

- Feature Extraction 또는 Fine-tuning

- 과적합 주의

- 검증 데이터로 확인

4단계: 평가 및 개선

- 정확도, 정밀도, 재현율 확인

- 하이퍼파라미터 조정

- 추가 데이터 수집

5단계: 배포

- 실전 테스트

- 모니터링

- 지속적 개선

전체 기간: 1주~1개월 ✅

전이학습의 장점과 한계

장점: 왜 모두가 쓸까?

1. 시간 절약 ⏰

전통적 학습: 수개월

전이학습: 수일

90% 시간 절약!2. 비용 절감 💰

전통적 학습: 수천만~수억 원

전이학습: 수만~수십만 원

99% 비용 절약!3. 적은 데이터로 가능 📊

전통적 학습: 수백만 장

전이학습: 수백~수천 장

1/1000 데이터로 가능!4. 높은 성능 ✅

기초 지식 활용

일반화 능력 좋음

처음부터와 비슷하거나 더 좋음5. 과적합 방지 🛡️

사전학습으로 일반 지식 있음

새 데이터에만 과적합 위험 낮음

안정적인 성능한계: 완벽하지 않아요

중고차의 비유:

장점:

✅ 빠름 (바로 운전)

✅ 저렴 (신차보다 쌈)

✅ 검증됨 (이미 테스트된 차)한계:

❌ 완벽하지 않음

❌ 이전 주인 습관 남음

❌ 새 용도에 맞지 않을 수 있음AI 전이학습도 비슷해요!

1. 도메인 차이 ⚠️

너무 다른 분야는 어려움

예:

자연 이미지 → 의료 영상

일반 텍스트 → 법률 문서

기초 지식이 맞지 않을 수 있음2. 편향 전이 ⚠️

기존 모델의 편향 그대로

예:

ImageNet: 서양 물체 중심

→ 동양 물체 인식 약함

BERT: 영어 중심

→ 한국어 이해 제한적3. 완벽하지 않음 ⚠️

처음부터 학습보다 성능 낮을 수 있음

특히:

- 새 작업이 매우 다를 때

- 데이터가 특이할 때

- 최고 성능이 필요할 때4. 모델 크기 ⚠️

사전학습 모델이 큼

예:

ResNet-50: 100MB

BERT-Large: 1.3GB

저장 공간 필요

실행 시 메모리 많이 씀주의사항

1. 적절한 모델 선택

✅ 좋은 선택:

이미지 분류 → ResNet (이미지로 학습)

텍스트 분류 → BERT (텍스트로 학습)

❌ 나쁜 선택:

의료 영상 → 음성 인식 모델

한국어 처리 → 영어 전용 모델2. 데이터 품질

적어도 품질은 좋아야 함

✅ 정확한 라벨

✅ 다양한 케이스

✅ 대표성 있는 샘플

적은 수 × 좋은 품질 > 많은 수 × 나쁜 품질3. 과적합 주의

Fine-tuning 시:

- 학습률 낮게

- Early Stopping 사용

- 검증 데이터로 확인

- Regularization 적용4. 라이선스 확인

상업적 사용 가능한지 확인

✅ MIT, Apache 2.0: 자유롭게 사용

⚠️ GPL: 조건부 사용

❌ 연구용 전용: 상업 사용 불가

꼭 확인하세요!전이학습 - 효율적인 AI 개발

오늘 우리는 전이학습의 모든 것을 배웠습니다!

오늘 배운 핵심 내용

✅ 전이학습이란?

- 지식의 재사용

- 기초는 그대로

- 새 작업만 학습

- 효율적!

✅ Feature Extraction

- 모델 동결

- 새 층만 학습

- 빠르고 안전

- 데이터 적을 때

✅ Fine-tuning

- 전체 재학습

- 최적화

- 더 정확

- 데이터 충분할 때

✅ 실전 활용

- 이미지 인식

- 자연어 처리

- 의료 진단

- 모든 분야!

✅ 장점과 한계

- 시간/비용 90% 절약

- 적은 데이터로 가능

- 도메인 차이 주의

- 편향 전이 조심

전이학습 실천 가이드

언제 사용할까?

✅ 데이터가 부족할 때

✅ 시간이 촉박할 때

✅ 예산이 제한될 때

✅ 빠른 프로토타입 필요할 때

→ 대부분의 상황! 🎯어떻게 시작할까?

1. 사전학습 모델 찾기

- Hugging Face

- TensorFlow Hub

- PyTorch Hub

2. 작은 데이터로 테스트

- 100장으로 시작

- 가능성 확인

3. 점진적 개선

- 데이터 추가

- Fine-tuning 시도

- 성능 향상

4. 실전 배포

- 모니터링

- 피드백 수집

- 지속 개선다음 이야기:

실전 응용을 배웠으니...

더 고급 기술을 배워볼까요?

다음 글에서는 멀티모달 AI에 대해 알아보겠습니다:

- 텍스트 + 이미지 함께 이해

- CLIP, DALL-E의 비밀

- 여러 정보를 동시에 처리

- AI의 다음 단계

Phase 5 (심화 단계), 기대하세요!

바퀴를 다시 발명하지 마세요. 전이학습으로 효율을 높이세요! 🎯

'AI' 카테고리의 다른 글

| [AI 개념 정리 14] 에이전트(Agent), 스스로 생각하고 행동하는 AI (0) | 2025.12.28 |

|---|---|

| [AI 개념 정리 13] 텍스트와 이미지를 함께 이해하는 AI, 멀티모달 AI란? 사람처럼 보고, 듣고, 읽는 AI (3) | 2025.12.23 |

| [AI 개념 정리 11] 좋은 AI vs 나쁜 AI, 모델 평가 방법 쉽게 이해하기 (3) | 2025.12.15 |

| [프롬프트 엔지니어링 실전편] "글 써줘"는 이제 그만! 복사만 하면 되는 상황별 프롬프트 템플릿 14개 (0) | 2025.12.12 |

| [AI 개념 정리 10] 프롬프트 엔지니어링이란? 이것만 이해를 하세요 (0) | 2025.12.11 |